1 月 13 日消息,據英偉達官方博客,英偉達宣布推出一款名為 Nemotron-CC 的大型英文 AI 訓練數據庫,總計包含 6.3 萬億個 Token,其中 1.9 萬億為合成數據。英偉達聲稱該訓練數據庫可以幫助為學術界和企業界進一步推動大語言模型的訓練過程。

目前,業界各類 AI 模型的具體性能主要取決于相應模型的訓練數據。然而現有公開數據庫在規模和質量上往往存在局限性,英偉達稱 Nemotron-CC 的出現正是為了解決這一瓶頸,該訓練數據庫 6.3 萬億 Token 的規模內含大量經過驗證的高質量數據,號稱是 " 訓練大型語言模型的理想素材 "。

數據來源方面,Nemotron-CC 基于 Common Crawl 網站數據構建,并在經過嚴格的數據處理流程后,提取而成高質量子集 Nemotron-CC-HQ。

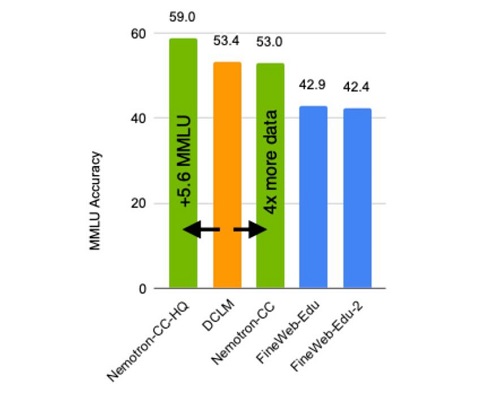

在性能方面,英偉達稱與目前業界領先的公開英文訓練數據庫 DCLM(Deep Common Crawl Language Model)相比,使用 Nemotron-CC-HQ 訓練的模型在 MMLU(Massive Multitask Language Understanding)基準測試中的分數提高了 5.6 分。

進一步測試顯示,使用 Nemotron-CC 訓練的 80 億參數模型在 MMLU 基準測試中分數提升 5 分,在 ARC-Challenge 基準測試中提升 3.1 分,并在 10 項不同任務的平均表現中提高 0.5 分,超越了基于 Llama 3 訓練數據集開發的 Llama 3.1 8B 模型。

英偉達官方表示,Nemotron-CC 的開發過程中使用了模型分類器、合成數據重述(Rephrasing)等技術,最大限度地保證了數據的高質量和多樣性。同時他們還針對特定高質量數據降低了傳統的啟發式過濾器處理權重,從而進一步提高了數據庫高質量 Token 的數量,并避免對模型精確度造成損害。

英偉達已將 Nemotron-CC 訓練數據庫已在 Common Crawl 網站上公開(點此訪問),英偉達稱相關文檔文件將在稍晚時候于該公司的 GitHub 頁中公布。