今年國際固態半導體電路會議(ISSCC)剛剛落下帷幕。ISSCC一向是半導體工業界巨頭展示最新研發成果的平臺之一,在今年的會議上也是如此,我們從不少巨頭發布的研究成果中看到了他們下一步的投入方向,從中也可以看到整體半導體行業的未來發展動向。

在本屆ISSCC上,除了DRAM等傳統強項之外,韓國半導體巨頭三星和SK Hynix最引人注目的方向可以說是人工智能相關芯片。雖然說人工智能芯片目前已經有許多大公司在積極投入,但是大多數大公司的做法往往是要么在自己已有的相關IP上做進一步迭代更新以滿足人工智能的需求(例如高通將Hexagon DSP進一步拓展適配人工智能算法,Cadence將Tensilica迭代加速機器學習算法等),這么做往往是針對于這一代人工智能算法的需求做產品,而沒有太多前瞻性;要么是和高校一起做研發,這樣通常比較偏科研性質。而三星和SK Hynix的主要不同在于,在本屆ISSCC上發表的人工智能芯片都是自主研發,并且有明確的產品化方案(或者已經在進行產品化),這樣兼顧下一代技術探索同時又有明確產品化可以說是三星在人工智能芯片的獨特之處。

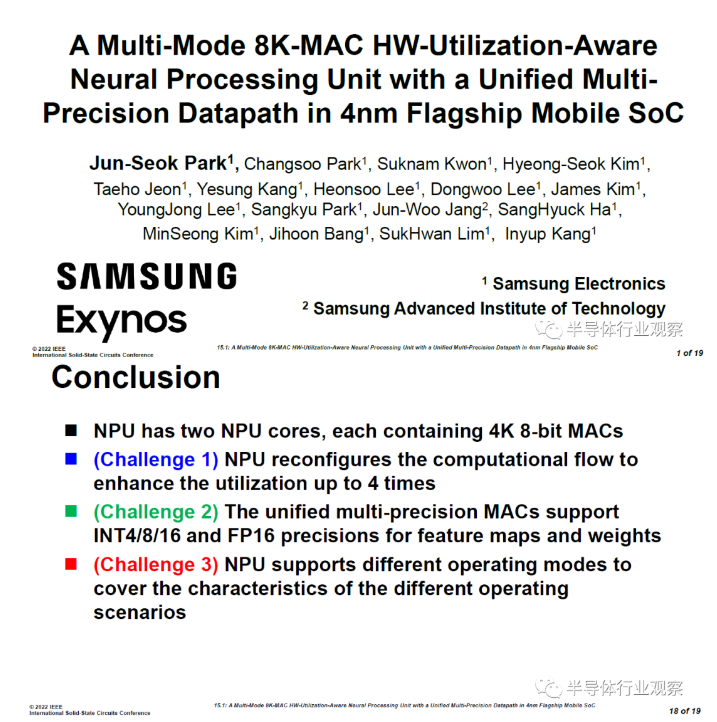

在今年的ISSCC上,三星發表了一篇是關于移動端NPU的論文,目前已經使用在其4nm Exynos SoC中;而SK Hynix則發表了關于基于GDDR-6的DRAM存內計算的論文,并且官方宣布將會和韓國的AI芯片公司Sapeon合作進一步推廣GDDR存內計算生態。

三星的NPU論文的主要關注點在于進一步優化數據流以提升計算單元利用率、優化計算單元以覆蓋不同的計算精度、提供不同的工作模式以滿足不同功耗和性能的需求。其中第一點是幾乎所有NPU都要解決的問題,而在計算單元優化方面,三星的NPU可以覆蓋INT4、INT8和FP16幾種精度,這些計算精度基本上能覆蓋移動端人工智能算法所有的需求(例如INT4針對較為簡單的網絡,而FP16針對較為復雜對于精度要求更高的網絡)。另一方面,該NPU有高性能模式和低功耗模式兩種工作模式,從而滿足移動端不同應用場景之間的切換。從這兩點來看,可以說該NPU的設計確實是在覆蓋手機芯片在日常應用中的痛點,其優化的方向有非常明確的實際應用場景,可以說已經是經過許多實戰的打磨。我們認為,三星的論文標志著它的NPU技術說明它在產業化上已經有了很深厚的積累。

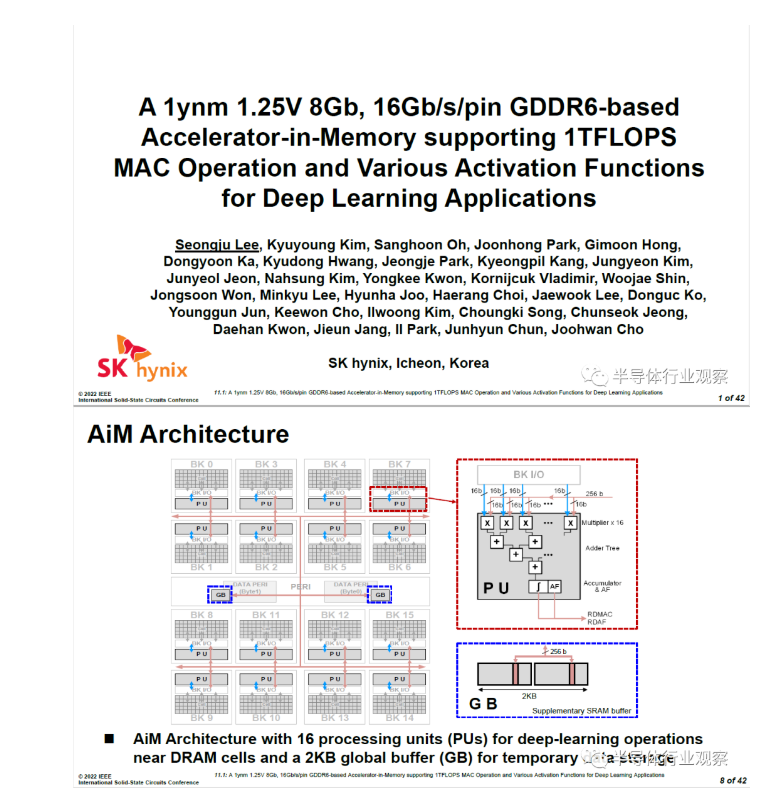

韓國的另一個半導體巨頭SK Hynix則在今年的ISSCC上發表了基于GDDR接口的DRAM存內計算。在人工智能應用中,內存訪問決定了許多模型的運行速度,因此越來越多公司和機構在探索存內計算,即將計算直接在存儲器中運行,這樣就省去了內存訪問的開銷。基于DRAM的存內計算則非常尤其適合云端和邊緣端的人工智能算法,而這次SK Hynix發表在ISSCC 2022的DRAM存內計算(Accelerator in Memory, AiM)研究中,使用了將計算單元集成在DRAM存儲芯片中的架構并完成了4Gb AiM芯片,通過DRAM控制器,該DRAM既可以做存內計算,又可以當作正常的DRAM來使用。論文測量結果顯示,AiM相對傳統的GPU+HBM2在常用機器學習模型中可以實現高達10倍的性能提升。我們認為,DRAM中的存內計算有可能會成為DRAM行業下一步的新方向,有可能會成為一個新的DRAM品類——值得注意的是,DRAM巨頭三星在去年也發布了類似的DRAM存內計算研究和計劃,我們預計該方向將會在未來獲得更多的關注和投入。

韓國的另一個半導體巨頭SK Hynix則在今年的ISSCC上發表了基于GDDR接口的DRAM存內計算。在人工智能應用中,內存訪問決定了許多模型的運行速度,因此越來越多公司和機構在探索存內計算,即將計算直接在存儲器中運行,這樣就省去了內存訪問的開銷。基于DRAM的存內計算則非常尤其適合云端和邊緣端的人工智能算法,而這次SK Hynix發表在ISSCC 2022的DRAM存內計算(Accelerator in Memory, AiM)研究中,使用了將計算單元集成在DRAM存儲芯片中的架構并完成了4Gb AiM芯片,通過DRAM控制器,該DRAM既可以做存內計算,又可以當作正常的DRAM來使用。論文測量結果顯示,AiM相對傳統的GPU+HBM2在常用機器學習模型中可以實現高達10倍的性能提升。我們認為,DRAM中的存內計算有可能會成為DRAM行業下一步的新方向,有可能會成為一個新的DRAM品類——值得注意的是,DRAM巨頭三星在去年也發布了類似的DRAM存內計算研究和計劃,我們預計該方向將會在未來獲得更多的關注和投入。

臺積電:SRAM/下一代存儲器存內計算成亮點

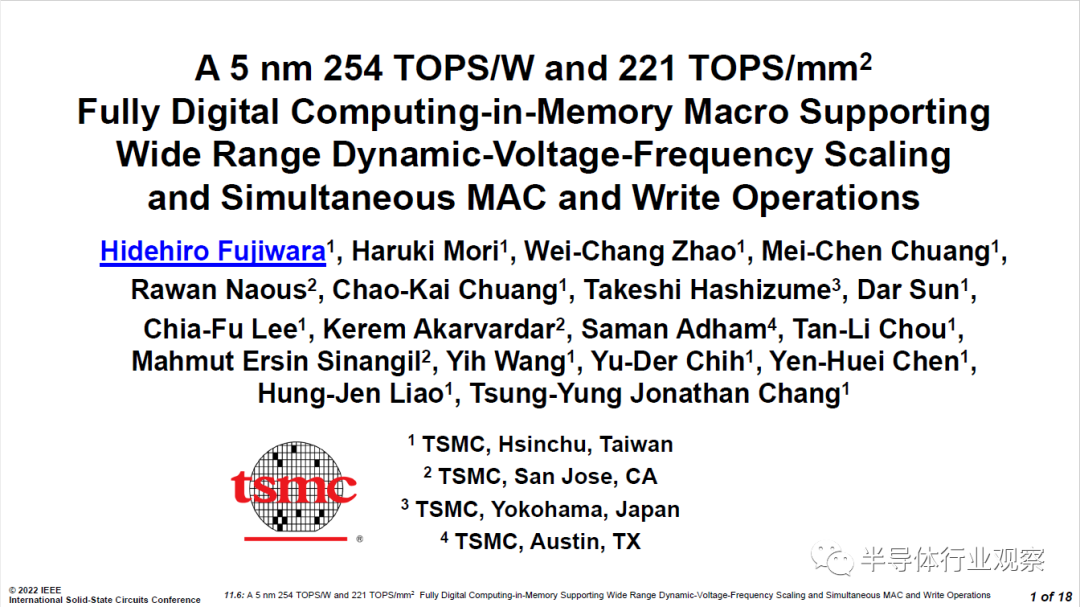

臺積電在人工智能方面的投入也很可觀。作為全球最大的代工廠,臺積電在人工智能領域的投入在本屆ISSCC上主要體現為帶有存內計算的片上存儲器IP,包括SRAM和下一代存儲器(RRAM,STT-MRAM)等。在本屆ISSCC上,臺積電共合作發表了六篇關于存內計算存儲器IP的論文,其中有一篇的作者全部來自臺積電,其余五篇則是臺積電和臺清大和佐治亞理工等高校合作。

臺積電對于基于SRAM和下一代片上存儲器存內計算研發投入的邏輯在于,基于芯片上存儲器的存內計算正在目前的人工智能應用,尤其是低功耗物聯網人工智能應用中得到越來越多的關注。如前面我們分析過的,內存訪問是人工智能模型運行速度和能效比的決定因素,物聯網應用對于能效比非常敏感,物聯網人工智能模型通常較小有機會可以放入SRAM和下一代片上存儲中,因此存內計算非常適合這些應用(相對而言,DRAM存內計算更適合需要運行大人工智能模型的云端應用)。SRAM一向是半導體工藝的一個重要基準(通常SRAM密度是衡量半導體工藝的一個重要參數),因此臺積電抓住下一代SRAM IP將對于鞏固其代工廠龍頭地位有重要作用。除此之外,RRAM這樣的下一代新興存儲器也在繼續發展壯大,因此對于臺積電來說也希望能抓住這樣的機會。帶有存內計算的SRAM和下一代存儲器也就成為了臺積電能提供帶有差異化IP的一個重要機會,因此我們看到臺積電在ISSCC上的眾多相關研究發表——這些發表的論文背后都是臺積電真金白銀的投入。

回到技術方面,本次由臺積電作為唯一作者機構在ISSCC上發表的SRAM論文是基于其5nm工藝,其64kb的IP可以實現在不同計算精度(INT4 – INT8)下實現非常高的計算密度(55.3-221.2 TOPS/mm2)和能效比(70 – 254 TOPS/W),這也證明了臺積電在SRAM存內計算領域的深厚積累(與此相對的是,三星的人工智能芯片領域的領先領域主要在NPU和DDR存內計算)。而在下一代存儲器方面,臺積電也在和臺清大、佐治亞理工等高校合作發表了多項新技術,涉及RRAM、STT-MRAM、相變存儲器等多種新存儲器,可見臺積電也是在多個新存儲器領域做了投入,希望能覆蓋到未來真正的主流下一代存儲器。

量子計算:下一代計算新范式

除了傳統應用芯片之外,量子計算也是本屆ISSCC的一個亮點。谷歌和IBM作為在量子計算領域投入最多的巨頭,也在本屆ISSCC上發表了相應的研究,其中IBM發表了一篇綜述研究,以及一篇用于量子計算控制的芯片;而谷歌則發表了一款關于其Sycamore量子計算芯片的綜述。

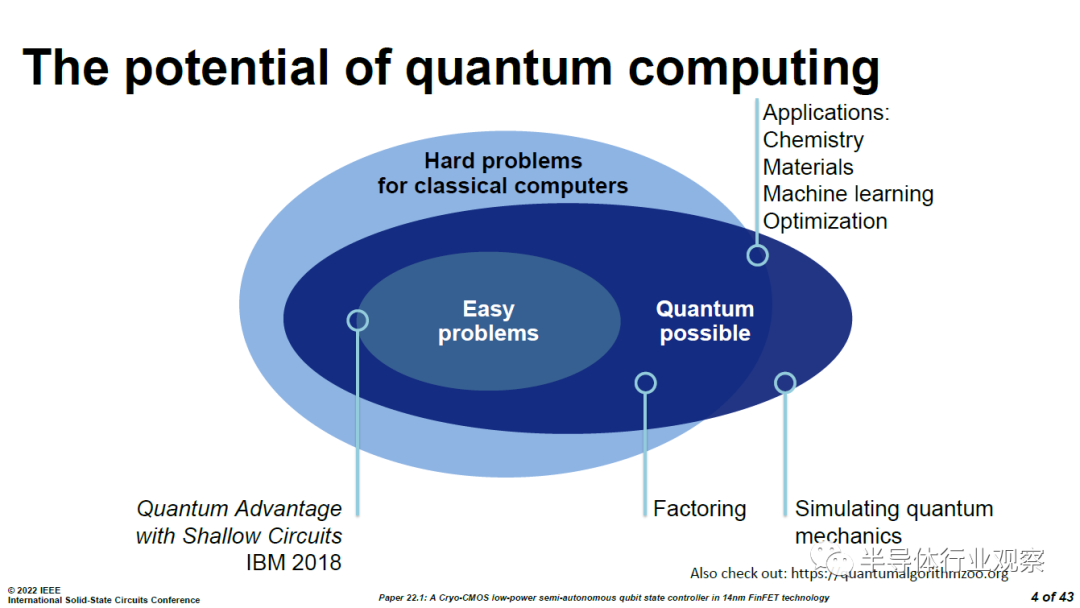

量子計算機到底應用在哪里?IBM在ISSCC上發表的研究中指出,量子計算的主要目的并不是取代傳統通用計算機,而是在一些專門的問題中(如質因數分解,化學相關模擬計算、優化問題)等獲得遠高于傳統計算機算法的處理速度,這是由于量子計算的獨特特性所決定的。

量子計算和集成電路芯片有什么關系?目前看來,量子計算的核心量子位(QuBit)可以使用基于可調頻率的諧振電路,這些量子位可以使用特殊半導體工藝在超低溫下實現;除此之外,另一個容易被忽略的和半導體芯片相關的部分是量子計算處理器的控制和讀出芯片。量子位的控制需要能產生高頻率的調制射頻信號,而在讀出部分則需要將相關信號以較高的采樣率讀出。事實上,這些控制和讀出都和目前已有的射頻電路由較為相似的結構(如正交變頻和可變增益等)和需求(例如高信噪比,高靈敏度等等)。谷歌在其論文中指出,控制和讀出芯片將會是量子計算機跨向下一步(即進一步增加量子位數)的關鍵,也可以說當量子計算機成為主流時,相關的控制和讀出芯片也可望會成為一個新的芯片品類市場。