摘 要: 傳統(tǒng)的神經(jīng)網(wǎng)絡(luò)表情識別系統(tǒng)由特征提取和神經(jīng)網(wǎng)絡(luò)分類器組成,利用人的經(jīng)驗(yàn)來獲取模式特征,很容易丟失表征表情特征的細(xì)節(jié)信息。提出一種基于卷積神經(jīng)網(wǎng)絡(luò)的識別方法,避免了對圖像進(jìn)行復(fù)雜的特征提取,直接把圖像數(shù)據(jù)作為輸入。通過在Cohn-Kanade表情庫上的實(shí)驗(yàn)結(jié)果表明,該方法能夠取得很好的表情分類效果。

關(guān)鍵詞: 卷積神經(jīng)網(wǎng)絡(luò);人臉表情識別

0 引言

表情識別已成為人類交流甚至人機(jī)交互過程的一個(gè)重要研究課題。關(guān)于面部表情識別的研究能幫助人們建立更加智能化和交互性良好的計(jì)算機(jī)系統(tǒng)。1971年,EKMAN P和FRIESEN W V研究了6種基本表情:高興、悲傷、驚訝、恐懼、憤怒和厭惡,并系統(tǒng)地建立了上千幅不同的人臉表情圖像庫[1]。由于人機(jī)交互研究的不斷深入和巨大的應(yīng)用前景,表情識別一直是模式識別和人工智能領(lǐng)域的一個(gè)研究熱點(diǎn)。

在過去的幾十年內(nèi),研究者已經(jīng)提出了很多基于神經(jīng)網(wǎng)絡(luò)(Back Propagation algorithm,BP)面部表情識別的方法。典型的多層神經(jīng)網(wǎng)絡(luò)(MLP)一般包括1~2個(gè)隱藏層,單純采用BP算法進(jìn)行訓(xùn)練[2]。有研究表明,增加MLP的隱藏層并不能提高網(wǎng)絡(luò)的性能,甚至?xí)蟠蠼档停硗釨P算法容易陷入局部最小值[3],而且識別效果的好壞取決于人工選擇的特征是否合理。人工選取特征是一件費(fèi)時(shí)、費(fèi)力的方法,為了達(dá)到好的效果需要大量的特征,甚至需要依賴專業(yè)知識,有些領(lǐng)域難以實(shí)現(xiàn)。特征的數(shù)量和質(zhì)量成為識別系統(tǒng)發(fā)展的瓶頸。

為解決上述問題,本文提出一種基于卷積神經(jīng)網(wǎng)絡(luò)的識別方法,直接在輸入表情圖像上自動(dòng)地學(xué)習(xí)多層特征和分類。實(shí)驗(yàn)證明,基于卷積神經(jīng)網(wǎng)絡(luò)的表情識別有較高的精度和很好的魯棒性。

1 卷積神經(jīng)網(wǎng)絡(luò)

1988年,LECUN Y等人[4]提出的卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Networks,CNN)是第一個(gè)成功訓(xùn)練多層網(wǎng)絡(luò)的學(xué)習(xí)算法。CNN作為深度學(xué)習(xí)模型的一種,通過局部空間映射關(guān)系減少需要訓(xùn)練的參數(shù)數(shù)目來提高反向傳播算法的訓(xùn)練性能。2012年,HINTON G E等人[5]將CNN應(yīng)用于ImageNet(圖像識別目前最大的數(shù)據(jù)庫)上,采用deep net結(jié)構(gòu),最終取得了非常驚人的結(jié)果,其結(jié)果相對原來方法好了很多(前5個(gè)錯(cuò)誤率由25%降低為17%)。由于CNN可以直接從原始圖像中學(xué)習(xí)模式特征,避免了復(fù)雜的特征提取和數(shù)據(jù)重建過程,已成功應(yīng)用于手寫字符識別[6]、人臉識別[7]、人眼檢測[8]、車牌字符識別[9]、交通信號識別[10]等眾多應(yīng)用領(lǐng)域。CNN的結(jié)構(gòu)框架和理論推導(dǎo)可參閱參考文獻(xiàn)[11]。

2 基于卷積神經(jīng)網(wǎng)絡(luò)的算法結(jié)構(gòu)設(shè)計(jì)

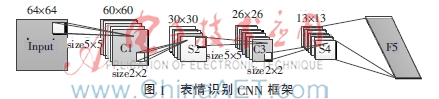

本文采用6層結(jié)構(gòu)的卷積神經(jīng)網(wǎng)絡(luò),包括2層卷積層(C)、2層抽樣層(S)和1層全連接層(F),如圖1所示。

CNNs網(wǎng)絡(luò)模型學(xué)習(xí)步驟如下:

(1)在C1層做卷積操作,本文使用5×5的窗口對輸入圖像進(jìn)行卷積操作,在這一層,如果需要,還會(huì)進(jìn)行包括圖像歸一化(本文將圖像大小歸一化為64×64)。本文在該層設(shè)置5幅特征圖,此時(shí)特征圖的大小為60×60。

(2)在S2中對C1進(jìn)行抽樣,抽樣窗口設(shè)置為2×2,此時(shí)特征圖數(shù)目不變?nèi)詾?幅,大小為30×30。

(3)C3設(shè)置了9幅特征圖,對S2進(jìn)行卷積,用5×5的卷積核,此時(shí)特征圖大小為26×26。

(4)在S4層對C3抽樣窗口設(shè)置為2×2,此時(shí)該層特征數(shù)目仍為9,大小為13×13。

(5)通過全連接到F5層,設(shè)置神經(jīng)元個(gè)數(shù),神經(jīng)元的個(gè)數(shù)通常與分類的類別數(shù)有關(guān),因此在輸出層F6設(shè)置6個(gè)神經(jīng)元。

(6)設(shè)計(jì)好網(wǎng)絡(luò)結(jié)構(gòu)后,用反向傳播算法,求取網(wǎng)絡(luò)的解。

(7)當(dāng)?shù)贸鏊形粗獏?shù)后,輸入一幅圖像,在網(wǎng)絡(luò)輸出層會(huì)給出輸出類別。

3 實(shí)驗(yàn)結(jié)果及分析

本文選取的實(shí)驗(yàn)樣本包括兩個(gè)部分:Cohn-Kanade表情庫和自拍的表情圖像。其中,Cohn-Kanade表情庫包含的圖像總數(shù)為1 825幅,分為憤怒(386幅)、驚訝(360幅)、厭惡(265幅)、恐懼(255幅)、高興(300幅)、悲傷(259幅)共6類;自拍的表情圖像包含的圖像總數(shù)為1 264幅,分為憤怒(211幅)、驚訝(215幅)、厭惡(204幅)、恐懼(214幅)、高興(210幅)、悲傷(210幅)6類。

為了驗(yàn)證本文方法的有效性,分別進(jìn)行3組實(shí)驗(yàn)。

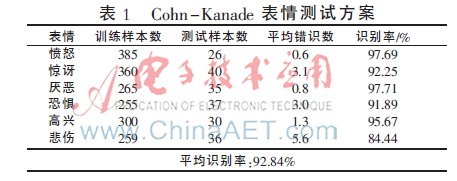

(1)用Cohn-Kanade表情庫的樣本進(jìn)行訓(xùn)練和測試,一部分表情為訓(xùn)練樣本,一部分表情為測試樣本,且來自不同的人;每種表情均選擇其中90%作為訓(xùn)練樣本,10%作為測試樣本,循環(huán)10次,將10次的平均誤差作為測試結(jié)果,且實(shí)驗(yàn)中參加訓(xùn)練和測試的表情來自不同的人。測試結(jié)果如表1所示。

由表1可以看出,在Cohn-Kanade表情庫測試的識別率達(dá)到90%以上,實(shí)驗(yàn)證明,不做特征提取的卷積神經(jīng)網(wǎng)絡(luò)表情識別系統(tǒng)具備正確率高、泛化能力較強(qiáng)的能力。

圖2顯示了輸入表情圖像在卷積神經(jīng)網(wǎng)絡(luò)前幾層產(chǎn)生的特征圖,最左側(cè)是輸入人臉表情圖,從左到右依次是輸入層、C1層、S1層、C2層、S2層。從圖中可以看出,神經(jīng)網(wǎng)絡(luò)可以很好地提取表情特征。

(2)為了驗(yàn)證該算法的魯棒性,這部分實(shí)驗(yàn)采用自拍的圖像作為測試圖像。參加訓(xùn)練的表情圖像仍然來自Cohn-Kanade表情庫,測試表情來自實(shí)驗(yàn)室拍攝視頻剪輯成的圖像。測試結(jié)果如表2所示。

由表2可知,自拍表情方案的識別結(jié)果普遍較低,由于缺少充足的先驗(yàn)知識,并且亞洲人和歐美地區(qū)人的表情存在差異性,因此識別率偏低。

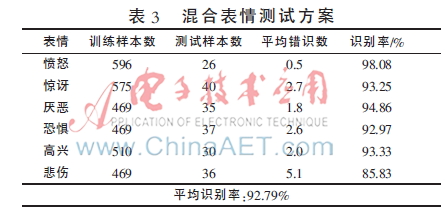

(3)為了提高識別率,將自拍圖像與Cohn-Kanade表情庫的圖像合并,然后重復(fù)第一個(gè)實(shí)驗(yàn)的方法,將合并后的表情庫圖像的90%作為訓(xùn)練樣本,10%作為測試樣本,循環(huán)10次進(jìn)行訓(xùn)練和測試,得到測試結(jié)果為10次的平均值。測試結(jié)果如表3所示。

由表3可知,部分表情識別率有所提高,而另一部分有所下降,平均識別率基本持平。實(shí)驗(yàn)表明,卷積神經(jīng)網(wǎng)絡(luò)能夠?qū)W習(xí)到樣本的共征,后一種情況間接證明了第二個(gè)實(shí)驗(yàn)的結(jié)論。

4 結(jié)論

卷積神經(jīng)網(wǎng)絡(luò)在處理二維圖像時(shí)有多個(gè)獨(dú)特優(yōu)點(diǎn):(1)無需復(fù)雜的特征提取;(2)可以將二維圖像直接輸入到神經(jīng)網(wǎng)絡(luò)中,大大減少了預(yù)處理的難度;(3)局部野和權(quán)值共享技術(shù)減少了參數(shù)空間,大幅度降低了算法的復(fù)雜度;(4)次抽樣技術(shù)增強(qiáng)了網(wǎng)絡(luò)的魯棒性,能容忍圖像一定程度的畸變。本文將卷積神經(jīng)網(wǎng)絡(luò)的算法用于人臉表情的識別,實(shí)驗(yàn)結(jié)果顯示該方法有較高的識別率和較好的魯棒性。為了提高自拍圖像的識別率,下一步除了建立一個(gè)更豐富的表情庫之外,需要進(jìn)行將不同的卷積神經(jīng)網(wǎng)絡(luò)試驗(yàn),尋找更適應(yīng)表情識別的卷積神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu)。

參考文獻(xiàn)

[1] EKMAN P, FRIESEN W V. Constants across cultures in the face and emotion[J]. J Pers Soc Psychol 1971, 17(2): 124-129.

[2] RUMELHART D E. Parallel distributed processing: exploration in the microstructure of cognition[M]. Cambridge, MA: MIT Press, 1986.

[3] 韓力群.人工神經(jīng)網(wǎng)絡(luò)理論、設(shè)計(jì)及應(yīng)用[J].北京:化學(xué)工業(yè)出版社,2001.

[4] LECUN Y, BOSER B, DENKER J S, et al. Backpropagation applied to handwritten zip code recognition[J]. Neural computation, 1989,1(4):541-551.

[5] KRIZHEVSKY A, SUTSKEVER I, HINTON G E. Imagenet classification with deep convolutional neural networks[C]. Advances in Neural Information Processing Systems 25 (NIPS′2012),2012.

[6] LECUN Y, BOTTOU L, BENGIO Y, et al. Gradient basedlearning applied to document recognition[C]. Proceedings of the IEEE, Berlin: IEEE,1998,86(11):2278-2324.

[7] LAWRENCE S, LEE G C, TSOI A C, et al. Face recognition: a convolutional neural network approach[J].IEEE Transonactions on Neural Networks,1997,8(1):98-113.

[8] TIVIVE F H C, BOUZERDO W N A, et al. An eye feature detector based on convolutional neural network[C]. Proceedings of the Eighth International Symposium on Signal Processing and Its Applications, 2005,1:90-93.

[9] 趙志宏,楊紹普,馬增強(qiáng),等.基于卷積神經(jīng)網(wǎng)絡(luò)LeNet-5的車牌字符識別研究[J].系統(tǒng)仿真學(xué)報(bào),2010,22(3):638-641.

[10] 陳先昌.基于卷積神經(jīng)網(wǎng)絡(luò)的深度學(xué)習(xí)算法與應(yīng)用研究[D].杭州:浙江工商大學(xué),2013.

[11] BOUVRIE J. Notes on convolutional neural networks[J]. Neural Nets, 2006.